卓越的头脑

突破性发现

GTC 2024 AI 盛会上的各项突破性成果,尽在掌握。

您可以随时随地观看由 NVIDIA 及我们的合作伙伴生态系统带来的精彩内容,了解在本届 GTC 上最新发布的硬件、软件和服务。见证技术突破如何改变生成式 AI、医疗健康、工业数字化、机器人等众多领域。

GTC 现场直击

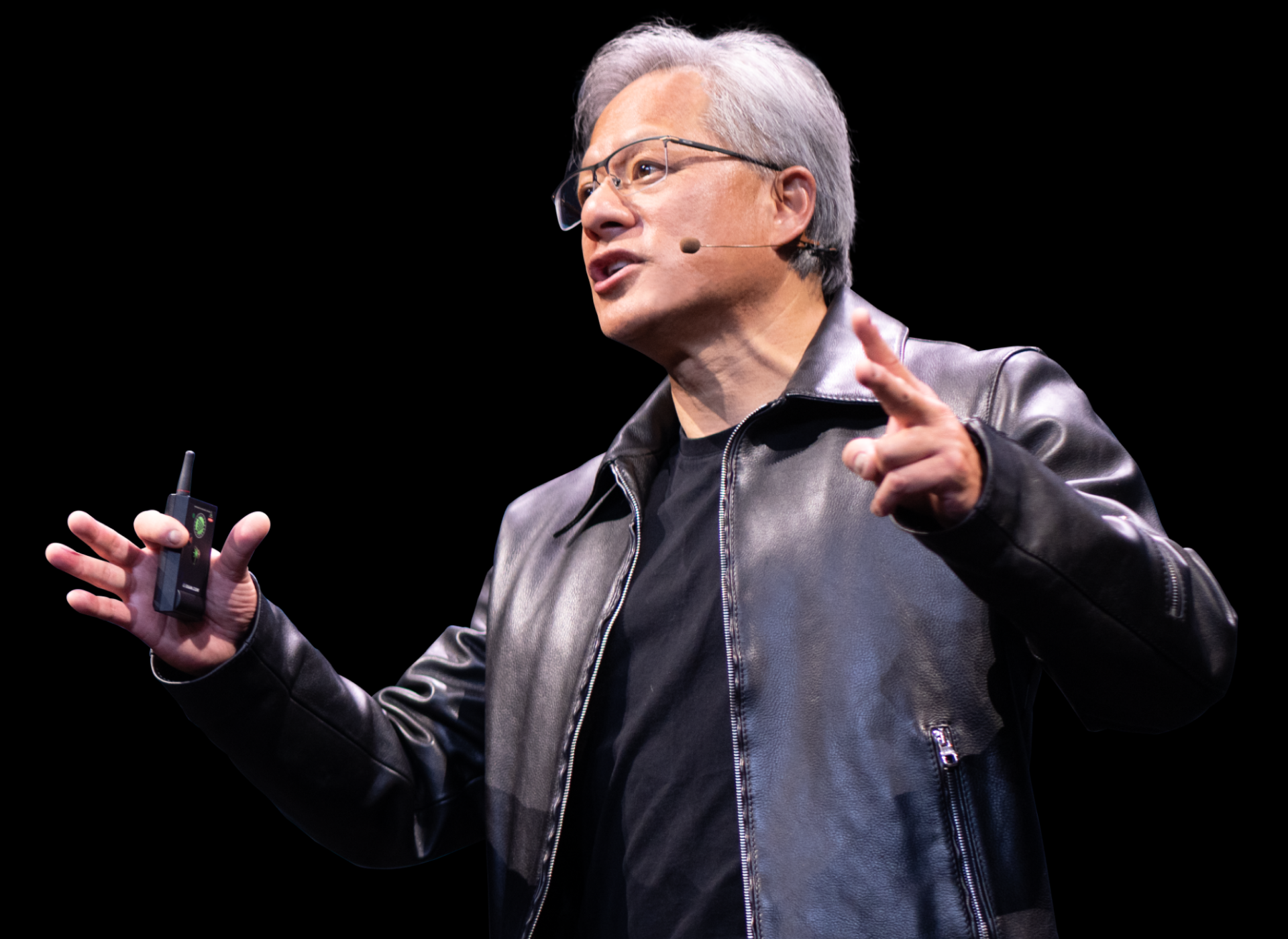

黄仁勋 | 创始人兼 CEO | NVIDIA

见证 AI 的变革时刻

观看黄仁勋在美国加州圣何塞 SAP 中心的主题演讲,听他分享塑造未来的 AI 突破。

中文内容精选推荐

见证这些具有突破性意义的圆桌讨论

聆听全球思想领袖的重要观点

钻石精英赞助商

钻石赞助商

学习、交流并获得灵感

- dli

- developer

- startups

参会者对 GTC 的评价

随时随地畅览精彩,及时了解技术进展并获得专家见解。